Особенности распределенной установки

Особенности подготовки оборудования

Подготовка оборудования для распределенной установки Платформы Радар производится аналогично подготовке оборудования для централизованной установки (см. раздел «Подготовка к установке»), кроме задач подготовки дисковой системы и настройки сетевых конфигураций.

Подготовки дисковой системы к распределенной установке

Для распределенной установки при разметке дисковой подсистемы для всех серверных ролей, кроме серверной роли DATA, необходимо учитывать следующие (стандартные) требования:

- корневой раздел (/) - все свободное пространство;

- раздел /home - 10 Гб;

- раздел swap - не менее 10% от общего объема оперативной памяти, из требований к ресурсам для конкретного модуля Платформы Радар (см. раздел «Требования к ТО»);

- тип файловой системы - XFS (при необходимости можно использовать EXT4).

Для серверной роли DATA необходимо провести процедуру разметки дисковой подсистемы Хранение данных, которая приведена в разделе «Подготовка дисковой подсистемы для реализации роли DATA».

Настройка сетевой конфигурации при распределенной установке

- Для доступа к веб-интерфейсам управления Платформой Радар нужно открыть порты:

- 9000

- 8080

- 8180

- Между узлами кластера необходимо разрешить взаимодействие в обе стороны по следующим портам:

- 9092

- 9200

- 5672

- 15672

- 5432

- 2092

- 8080

- 8086

- 9000

- 8180

- 6677

- 6630

- 22

Ниже в таблице 1 приведены необходимые сетевые настройки при распределенной установке Платформы Радар (независимо от вариантов распределенной установки).

Таблица 1 -- Сетевые настройки для распределенной установки Платформы Радар

| Исходящий | Входящий | Порты | Описание |

|---|---|---|---|

| Correlator | Master | 5672 | Чтение нормализованных событий из очереди для корреляции |

| Correlator | Master | 8086 | Передача результатов корреляции |

| Log-Collector | Balancer | 1500-5000, 9997-9999, 15403, 15404TCP/UDP | Передача данных от сборщика в балансировщик и менеджер очередей |

| Log-Collector | Источники событий | 21, 22, 135, 445, 1443, 3306, 5432, 5601 | Активный сбор событий |

| Log-Collector | Log-Collector | 4813 | Взаимодействие между двумя сборщиками |

| Log-Collector | Master | 9000 | Запрос конфигурационных данных |

| Master | Data | 9200 | Работа с сырыми событиями |

| Master | Correlator | 2092 | Управление правилами корреляции |

| Master | Log-Collector | 4805 4806 |

Мониторинг и сбор статистики. Управление сборщиком событий API |

| Master | Balancer Correlator Data Worker | 6676 | Управление агентами кластера |

| Master | Balancer Correlator Data Worker | 9100 | Мониторинг и сбор статистики |

| Master | Balancer | 9292, 9308 | Мониторинг и сбор статистики |

| Master | Data | 9114 | Мониторинг и сбор статистики |

| Worker | Balancer | 9092 | Чтения событий из менеджера очередей для их обработки |

| Worker | Master | 5672 | Передача нормализованных событий в очередь на корреляцию |

| Worker | Data | 9200 | Передача событий на хранение |

| Источники событий | Log-Collector | 162 SNMP trap; 4807 UDP receiver; 4808 TCP receiver; 4809 TCP receiver SSL/TLS; 4810 HTTP receiver; 4811 HTTPS receiver; 4812 NetFlow reciever |

Пассивный сбор событий |

| Пользователи Платформы Радар | Master | 8080 9000 6676 6677 |

Доступ к интерфейсу Платформы Радар, проверка API ключей |

| Data (с ролью Master) | Data (с ролью Data) | 9300 | Взаимодействие между нодами в кластере хранилища данных |

Также подробное описание сетевого взаимодействия для различных вариантов установки приведено в разделе «Сетевое взаимодействие».

Особенности распределенной установки Платформы Радар

Подготовка установочных файлов Платформы Радар

Подключитесь по SSH к Платформе Радар, используя полученный IP-адрес стенда и логин.

Внимание! Для запуска установки необходимо получить права суперпользователя.

Перейдите в каталог /var/tmp:

cd /var/tmp/

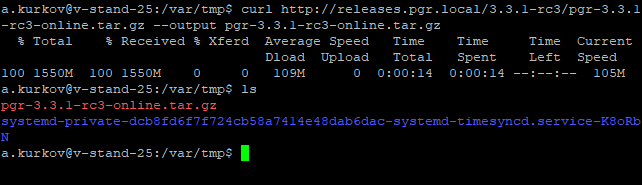

Далее загрузите установочный архив, например, командой curl. Командой ls убедитесь, что установочный архив загружен успешно и находится в каталоге /var/tmp (см. рисунок 1):

Рисунок 1 -- Загрузка установочного архива

Если скачан зашифрованный архив (файл с расширением *.enc), выполните команду для расшифровки:

openssl enc -aes-256-cbc -d -in pgr-RELEASE_VERSION-INSTALLATION_TYPE.tar.gz.enc | tar xz

Если скачан незашифрованный архив (файл с расширением *.tar.gz), выполните команду для разархивирования:

tar -zxvf pgr-RELEASE_VERSION-INSTALLATION_TYPE.tar.gz

Где название архива pgr-RELEASE_VERSION-INSTALLATION_TYPE.tar.gz.enc содержит: - RELEASE_VERSION - номер версии релиза Платформы Радар (например 3.3.1); - INSTALLATION_TYPE - тип установки (online или offline).

Командой ls убедитесь, что установочный скрипт install.sh расположен в директории /var/tmp/ после распаковки установочного архива.

Запуск инсталляционного скрипта и первичная установка системы{#start_inst}

Внимание! Перед запуском установки убедитесь, что сервер, на котором устанавливается Платформа Радар, подключен к сети Интернет.

Для корректной установки Платформы Радар в ОС Debian должна быть задана переменная PATH, содержащая полный список необходимых путей:

/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin. В случае, если переменная PATH не содержит путей/usr/sbinи/sbin, их следует добавить вручную.

- Находясь в директории

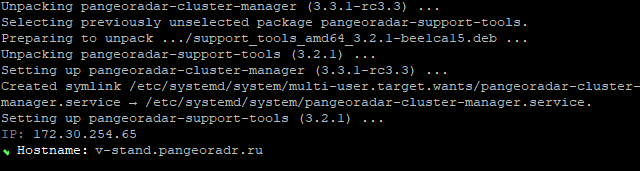

/var/tmp, выполните командуbash install.sh. Для выполнения команды с правами суперпользователя используйте командуsudo. Например,sudo bash install.sh. - Установка занимает некоторое время, в течение которого загружаются и устанавливаются модули Платформы Радар. Далее укажите внешний IP-адрес и доменное имя сервера (необязательно), на котором будет установлена Платформа Радар (см. рисунок 2).

Рисунок 2 -- Указание IP-адреса и имени сервера - Через некоторое время установка будет закончена на экране появится сообщение об успешном завершении:

Продолжите установку по адресу: `http://<УКАЗАННЫЙ ВАМИ IP>/install` Логин/Пароль по умолчанию - `admin/admin`

Продолжение установки и настройки Платформы Радар

- После перехода по адресу, указанному в конце работы инсталлятора (см. раздел "Запуск инсталляционного скрипта и первичная установка системы"), необходимо пройти процедуру авторизации (

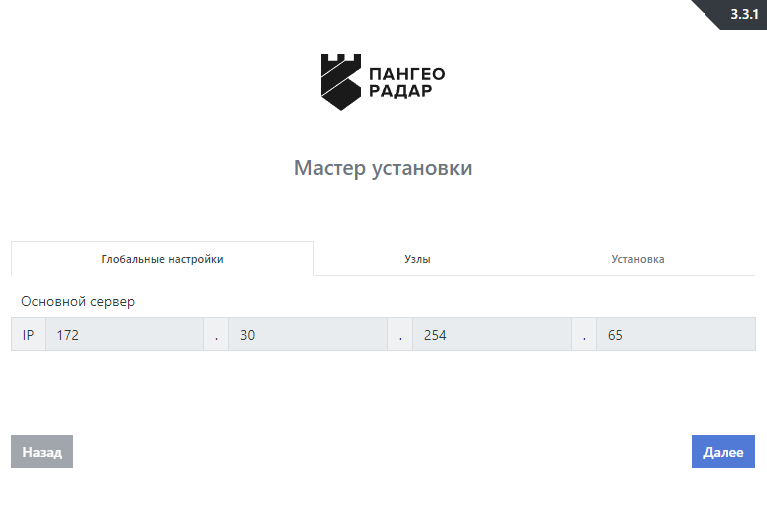

admin\admin) и смены пароля по умолчанию согласно руководству пользователя. После прохождения авторизации станет доступен этап получения лицензии Платформы Радар (подробнее см. раздел "Первичная активация лицензии") - После активации лицензии Нажмите кнопку далее, после чего будет отображен экран глобальных настроек (см. рисунок 3).

Рисунок 3 -- Экран продолжения установки Платформы Радар

- На данном экране нажмите на кнопку "Далее" и перейдите на экран настройки узлов (см. рисунок 4):

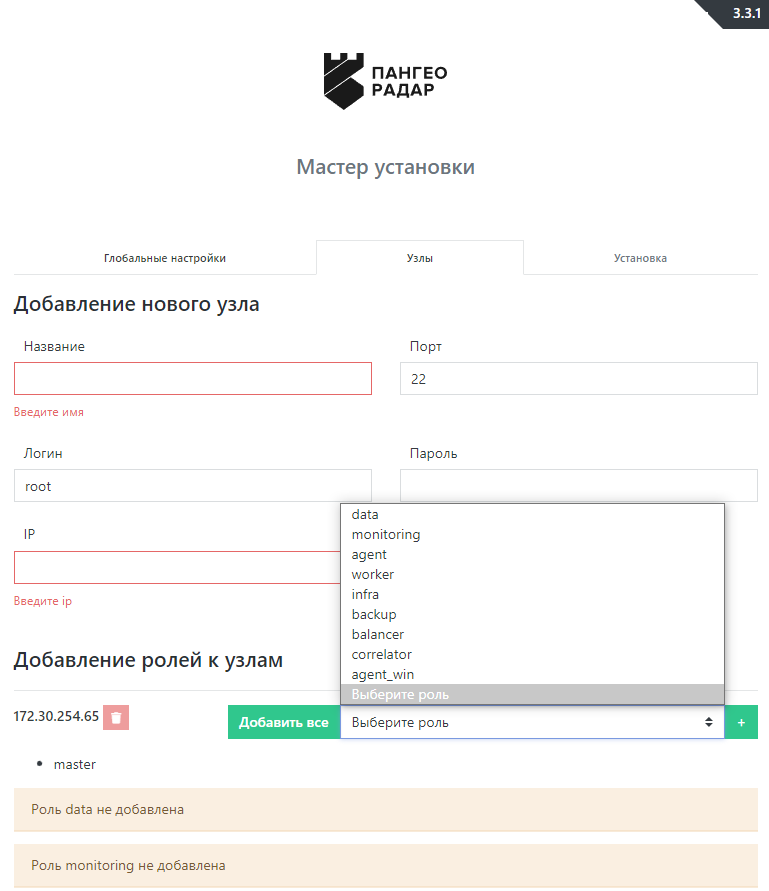

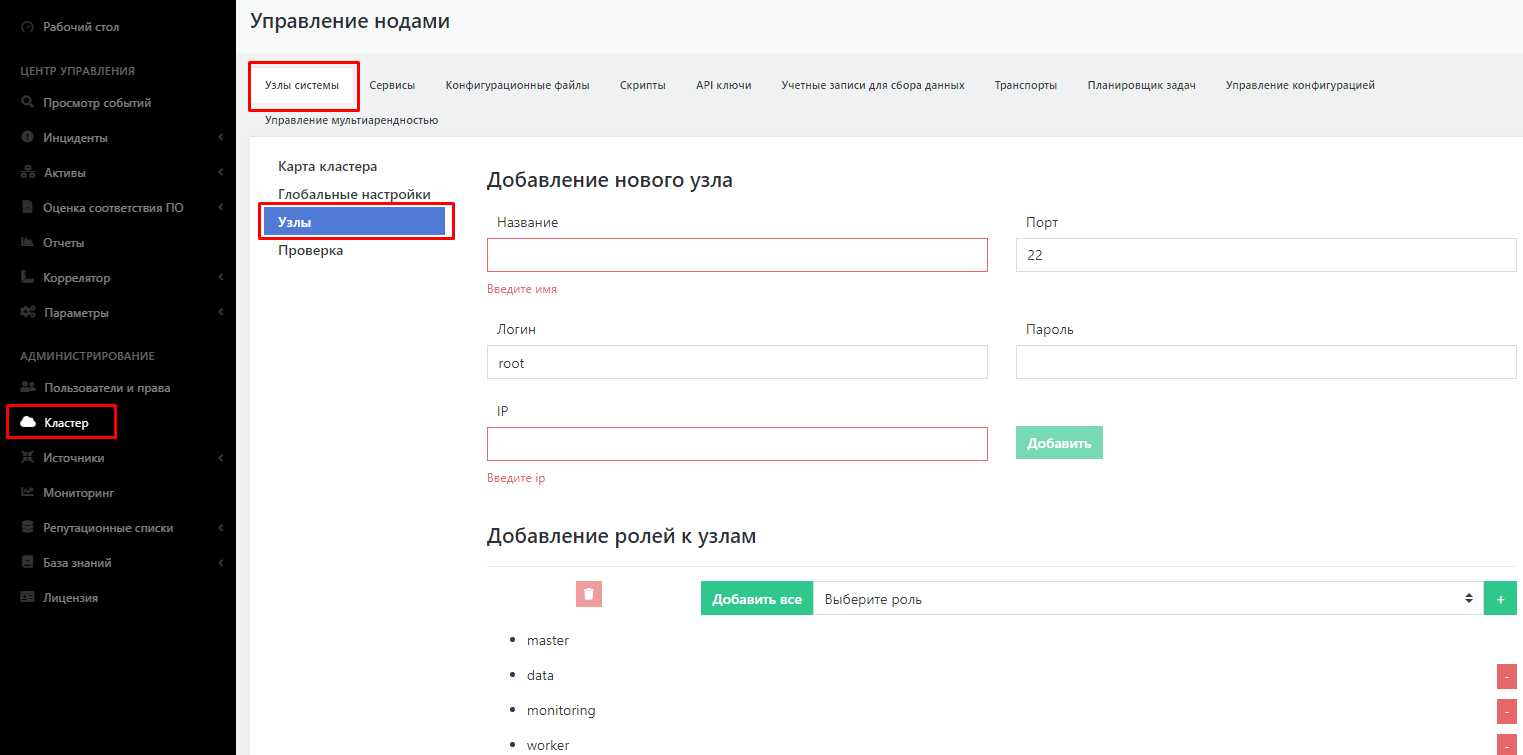

Рисунок 4 -- Экран настройки узлов Платформы Радар

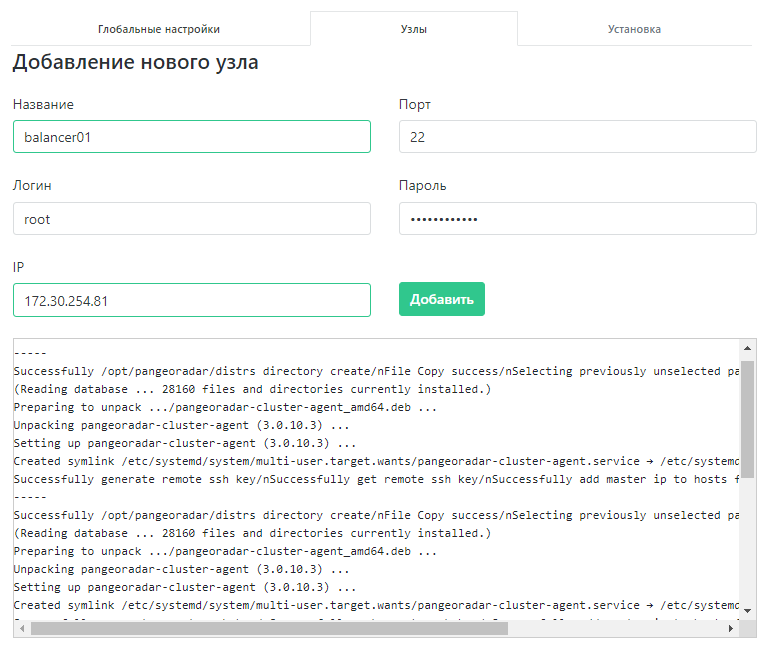

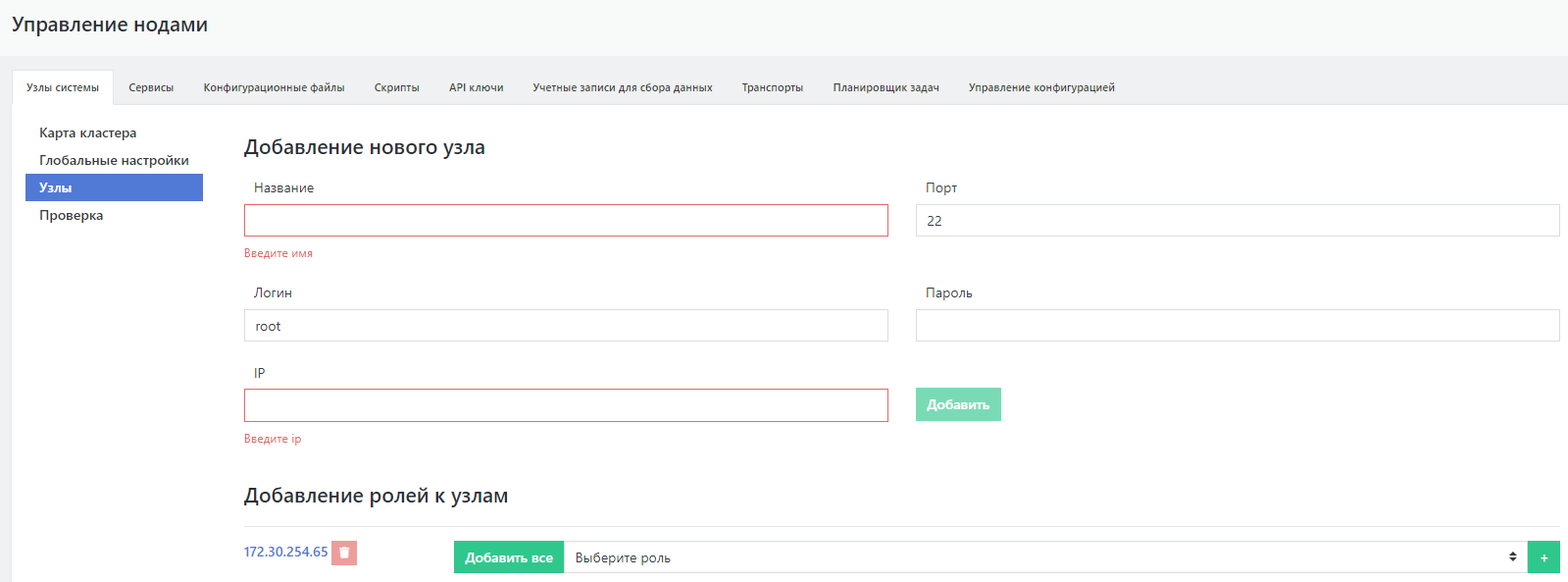

- При выполнении распределенной инсталляции Платформы Радар сначала необходимо добавить все узлы кластера через форму "Добавления нового узла" (см. рисунок 5):

Рисунок 5 -- Добавление нового узла

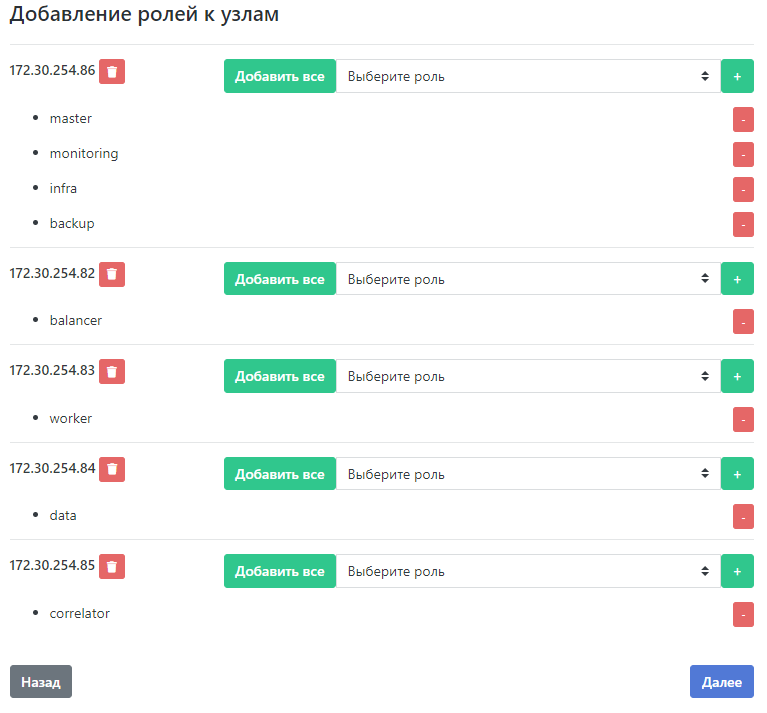

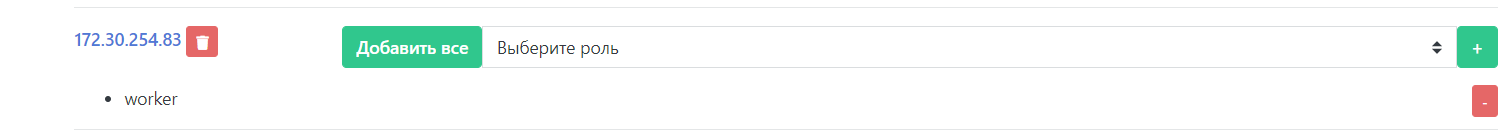

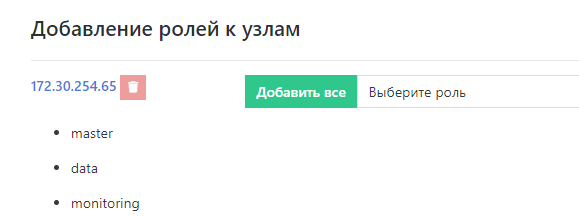

- После чего назначьте серверные роли согласно архитектуре проектного решения (см. рисунок 6):

Рисунок 6 -- Добавление ролей к узлам

- Далее перейдите к шагу "Установка" нажатием кнопки "Далее".

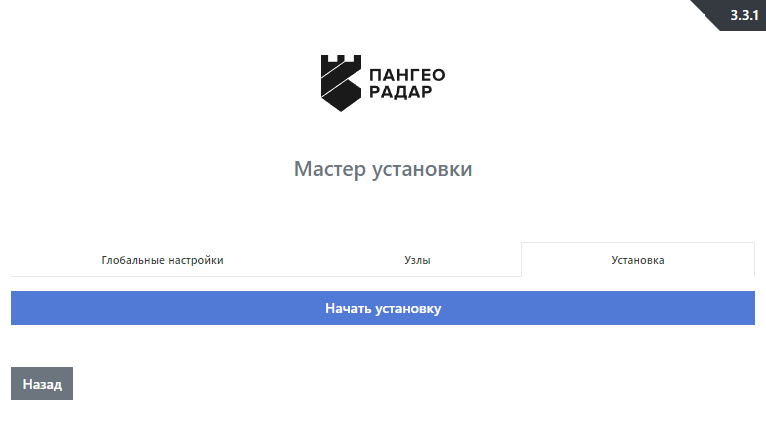

Запуск установки ролей Платформы Радар

- На экране старта установки (см. рисунок 7) нажмите на кнопку "Начать установку". После этого станет доступен экран просмотра журнала установки (см. рисунок 8);

Рисунок 7 -- Экран старта установки

Рисунок 8 -- Процесс установки

- Установка занимает некоторое время. По завершению процесса установки откроется Платформа Радар в меню администрирования Кластер - Узлы системы - Проверка

На этом установка Платформы Радар завершена, можно переходить к этапу проверки работоспособности ПО.

Проверка распределенной установки и работоспособности ПО

Для проверки наличия распределенной установки и работоспособности ПО выполните следующие действия:

-

Зайдите в графический интерфейс Платформы Радар с правами администратора.

-

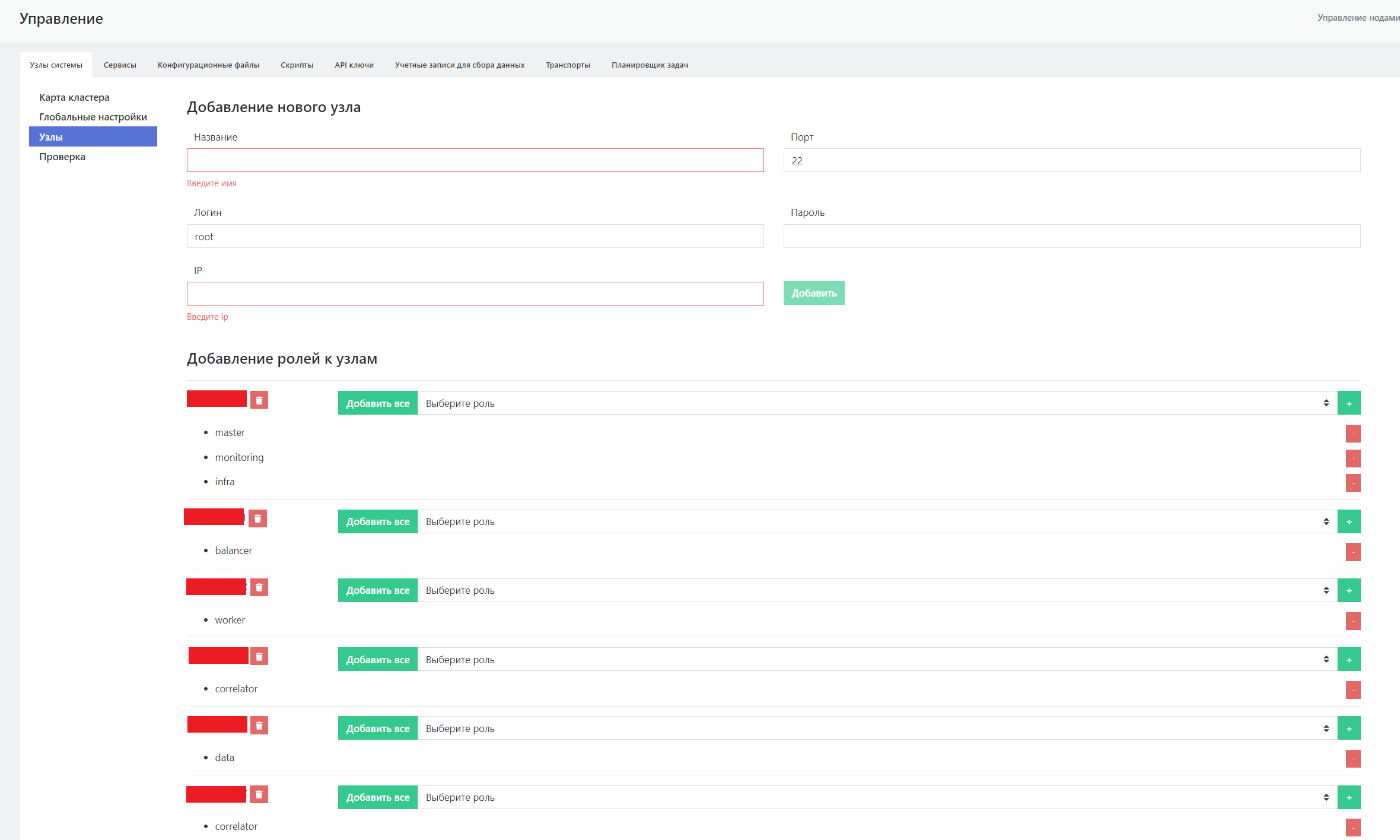

Перейдите в раздел Администрирование - Кластер - Узлы системы - Узлы (см. рисунок 9). Убедитесь что узлов в составе Платформы Радар больше одного, роли распределены по узлам (см. рисунок 10).

Рисунок 9 -- Раздел управления кластером

Рисунок 10 -- Список узлов Платформы Радар с указанием ролей

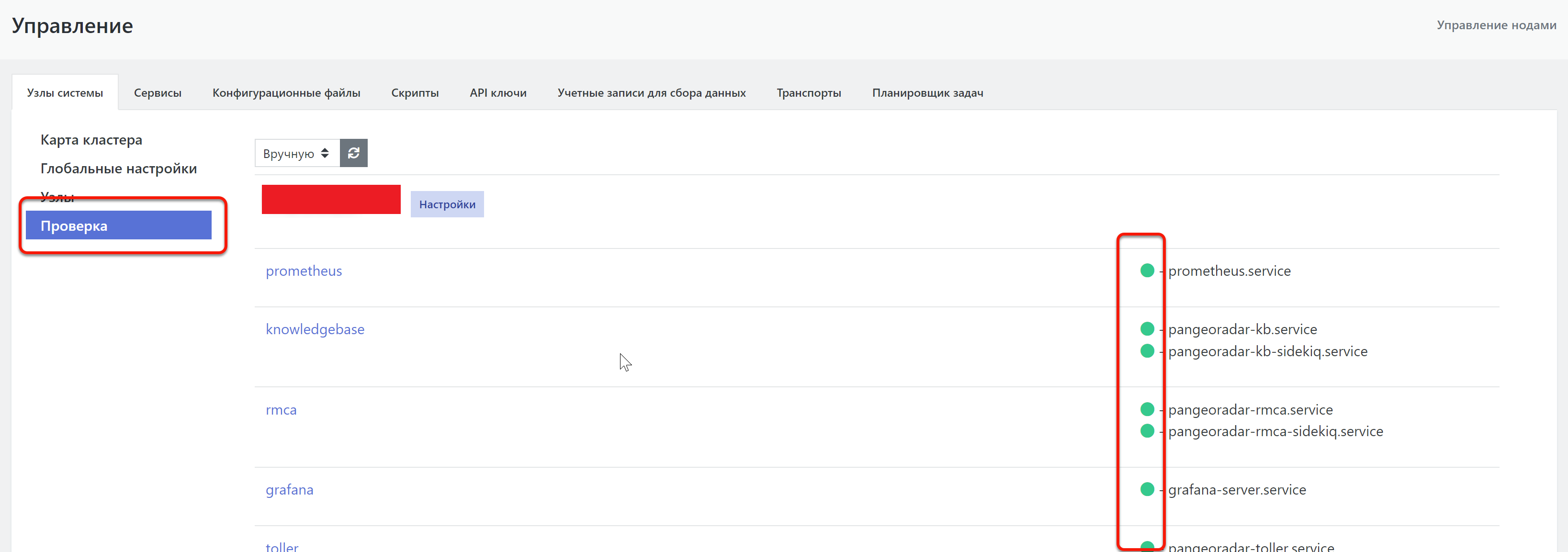

- Перейдите на вкладкк Узлы системы - Проверка (см. рисунок 11). Убедитесь, что список узлов и их ролей, совпадает с тем, что было задано при распределенной установке и настройке Платформы Радар, и на всех узлах индикация всех сервисов подсвечена зеленым, т.е. все сервисы находятся в рабочем состоянии.

Рисунок 11 -- Проведение проверки сервисов, установленных на узлах Платформы Радар

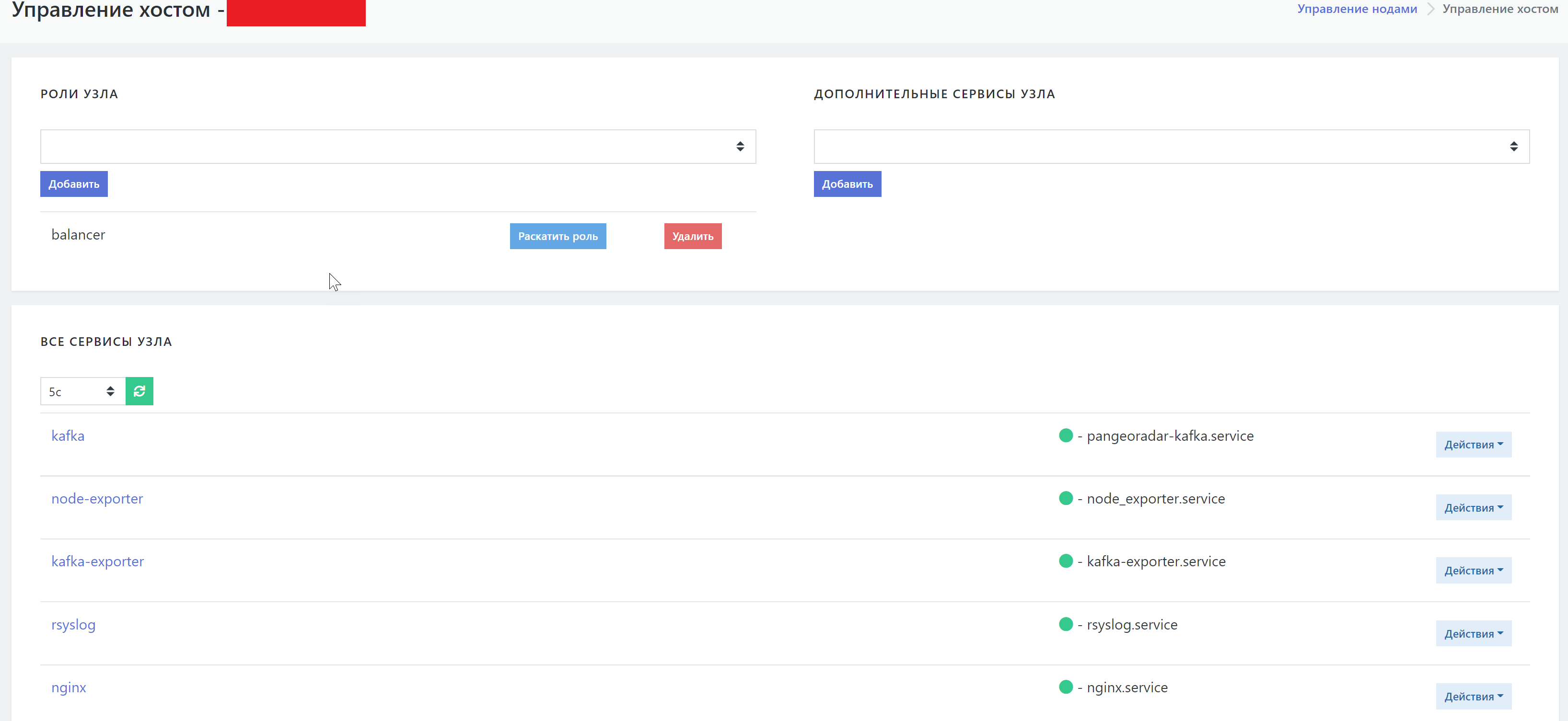

- Выберите один из узлов, например balancer, и нажмите кнопку "Настройки", расположенную справа от названия узла (см. рисунок 11). Откроется страница управления узлом и списком всех сервисов, установленных на данном узле (см. рисунок 12).

Рисунок 12 -- Страница с функциями управления хостом

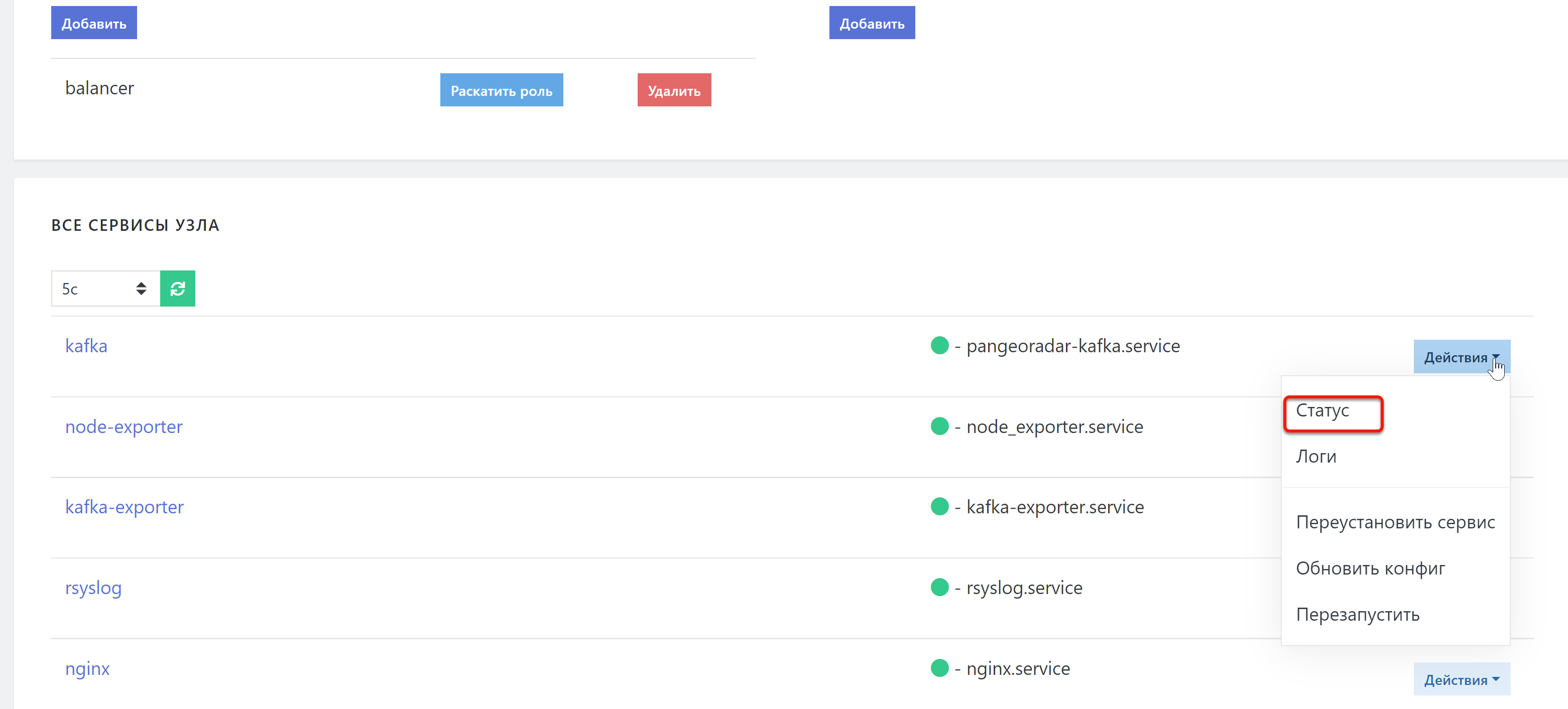

- На странице "Управление хостом" выберите интересующий сервис, например, kafka, и нажмите кнопку "Действия". В раскрывшемся списке выберите "Статус" (см. рисунок 13).

Рисунок 13 -- Выбор действий с компонентом

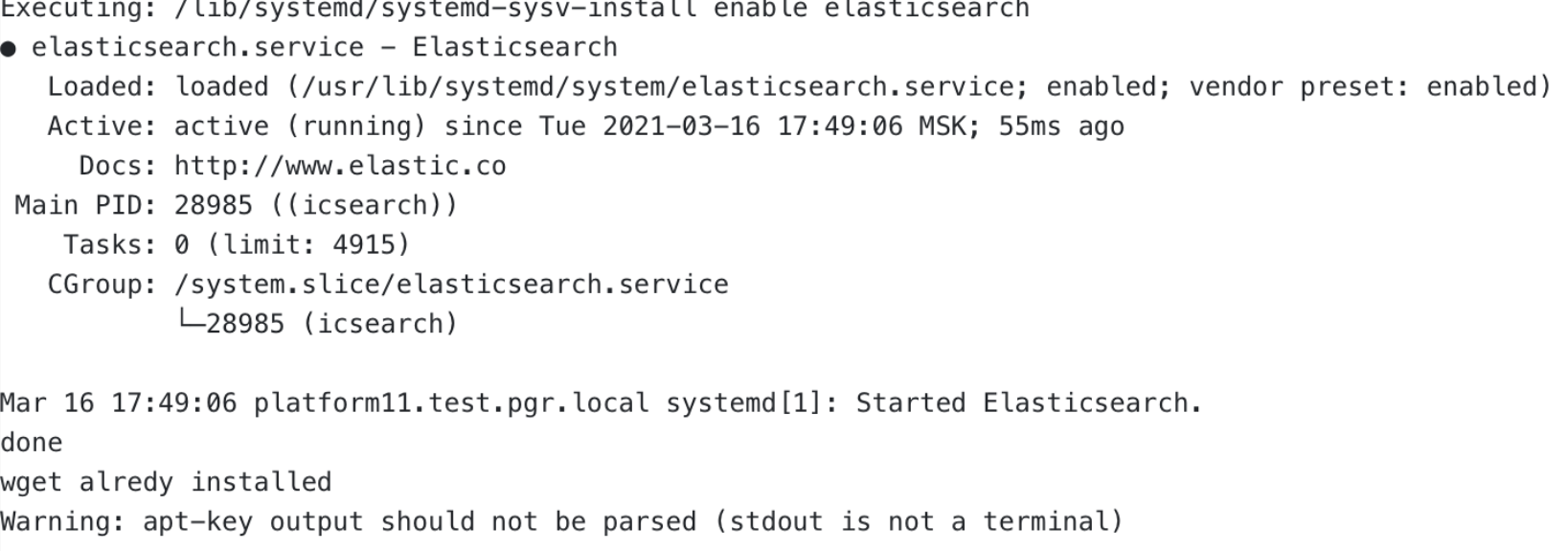

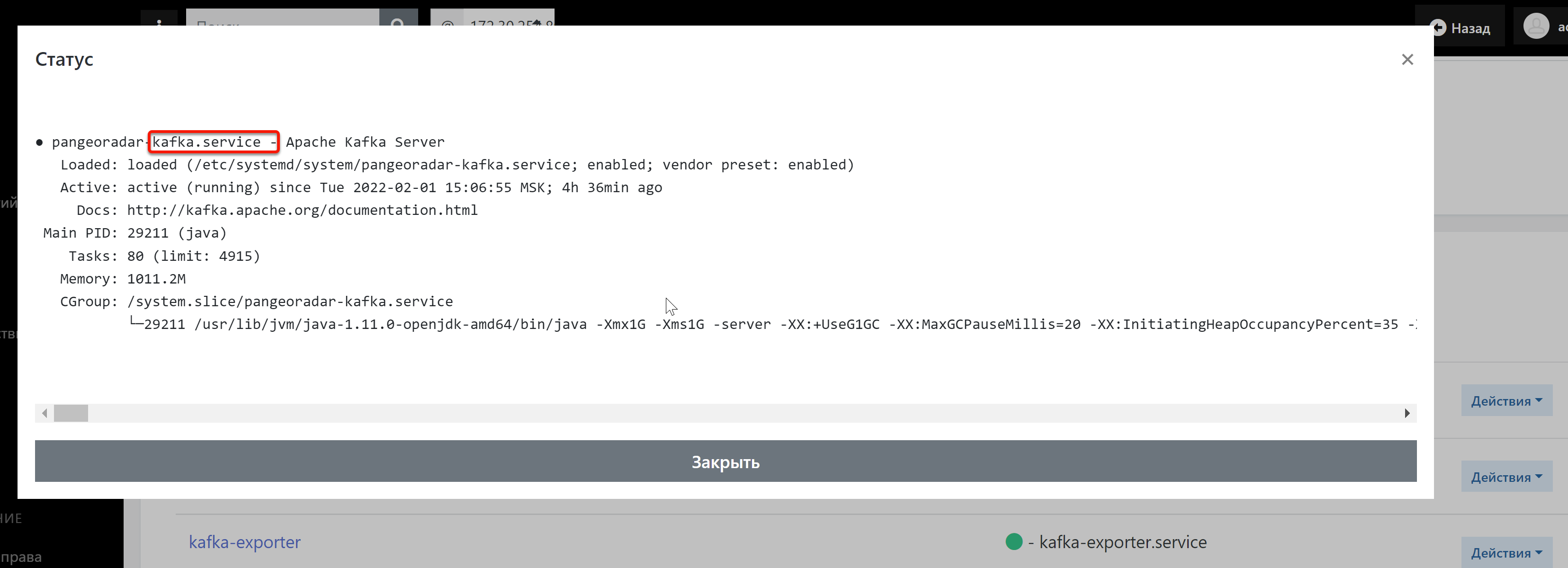

При выборе действия "Статус" на экран выводится информация о состоянии сервиса (см. рисунок 14).

Рисунок 14 -- Окно с информацией о состоянии сервиса

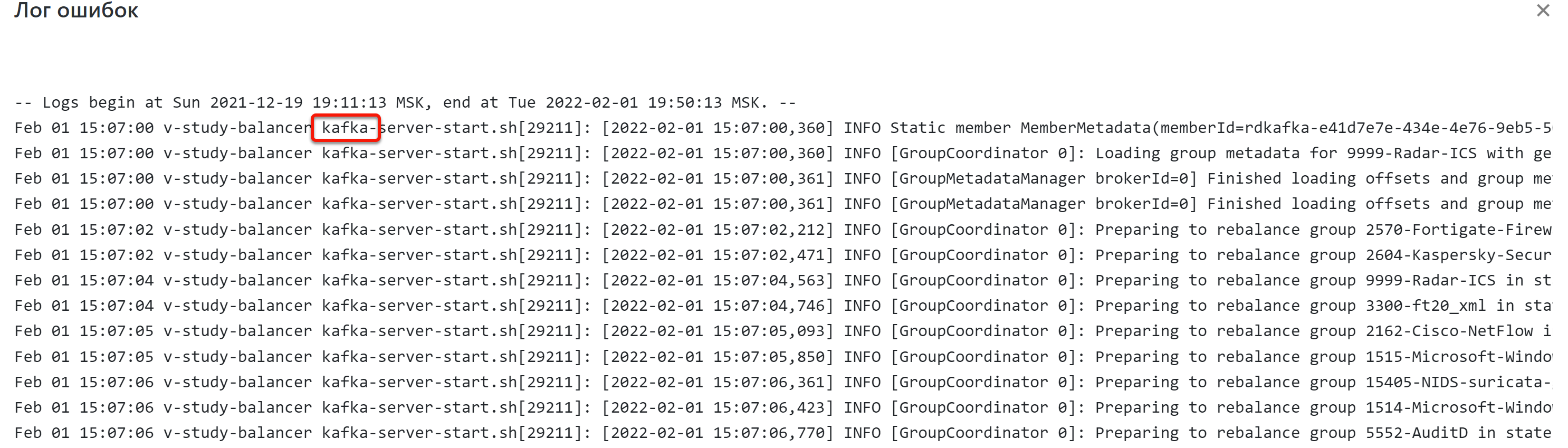

- В раскрывшемся списке "Действия" выберите "Логи" (см. рисунок 13).

При выборе действия "Логи" на экран выводится журнал событий сервиса (см. рисунок 15).

Рисунок 15 -- Окно вывода событий сервиса

Для подтверждения достоверности информации, полученной через веб-интерфейс Платформы Радар, можно подключиться удаленно по SSH к выбранному ранее для проверки узлу (balancer) и выполнить команду:

service pangeoradar-kafka status (указать сервис, который был выбран в ГПИ для проверки, в данном случае kafka)

В результате выполнения команды в окне терминала должна отобразиться та же информация о сервисе, что и в окне веб-интерфейса при выборе действия "Статус".

Далее выполните команду:

ip a

Полученный в результате выполнения команды IP-адрес должен совпадать с IP-адресом в веб-интерфейсе.

Первичное конфигурирование Платформы Радар

Первичное конфигурирование Платформы Радар включает создание и настройку следующих объектов:

- пользователи;

- группы пользователей;

- группы активов.

Подробное описание по созданию и настройке объектов приведено в документе «Руководство администратора».

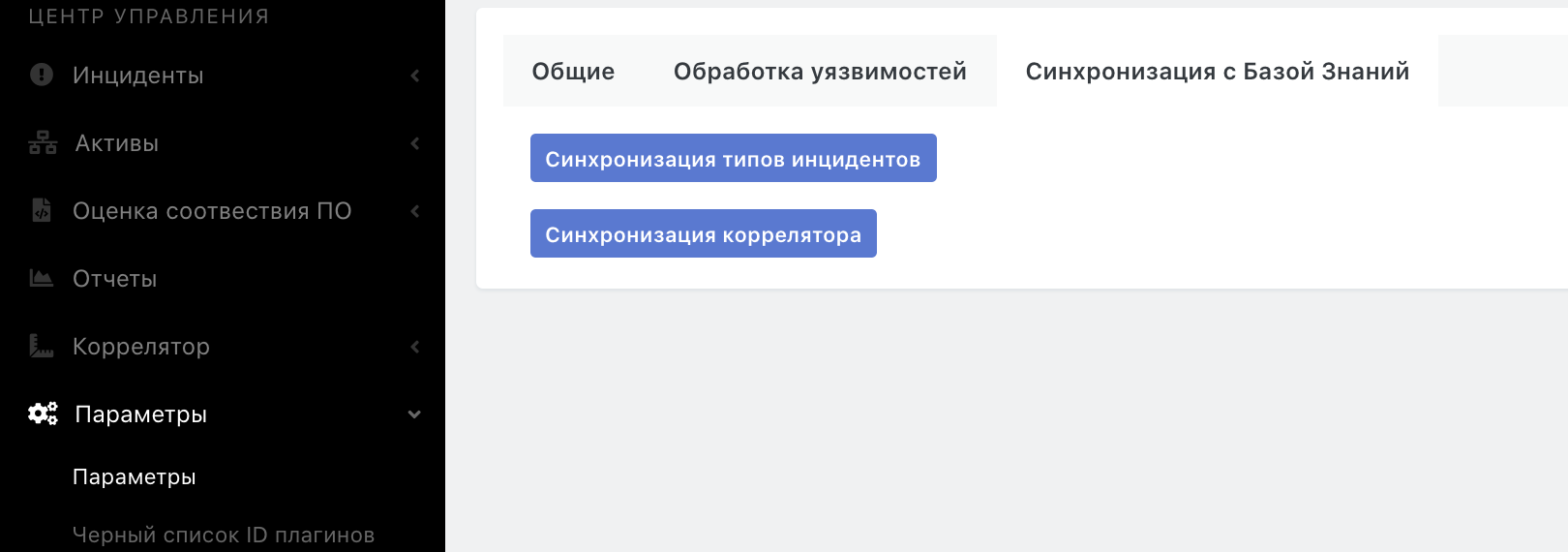

Синхронизация с Базой Знаний

При выполнении операций по синхронизации с Базой Знаний необходимо выполнить следующие действия:

- синхронизировать типы инцидентов;

-

синхронизировать правила для Коррелятора.

-

Для этого перейдите в раздел Центр управления - Параметры - Параметры и выберите вкладку "Синхронизация с Базой Знаний".

- Нажмите на кнопки "Синхронизация типов инцидентов" и "Синхронизация коррелятора" (см. рисунок 16).

Рисунок 16 -- Вкладка синхронизации с Базой Знаний

Синхронизация правил для коррелятора может занимать некоторое время.

Добавление нового узла кластера

При необходимости расширения производительных возможностей Платформы Радар существует возможность добавить дополнительный экземпляр узла с той или иной ролью.

- Для этого перейдите в меню администрирования Кластер - Узлы системы - Узлы, заполните форму добавления узла и добавьте к узлу необходимую роль (см. рисунок 17).

Рисунок 17 -- Добавление нового узла кластера

- Далее - перейдите в настройки созданного узла кластера, для этого необходимо нажать на IP-адрес этого узла (см. рисунок 18 ).

Рисунок 18 -- Созданный узел кластера

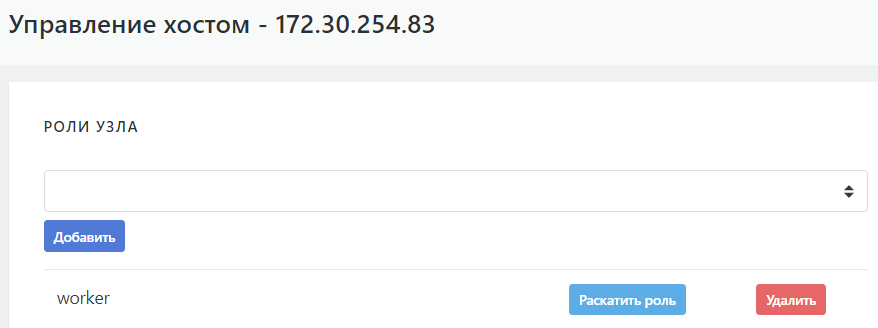

- В настройках созданного узла нажмите на кнопку "Раскатить роль" напротив добавленной роли (см. рисунок 19).

Рисунок 19 -- Установка роли на новый узел кластера

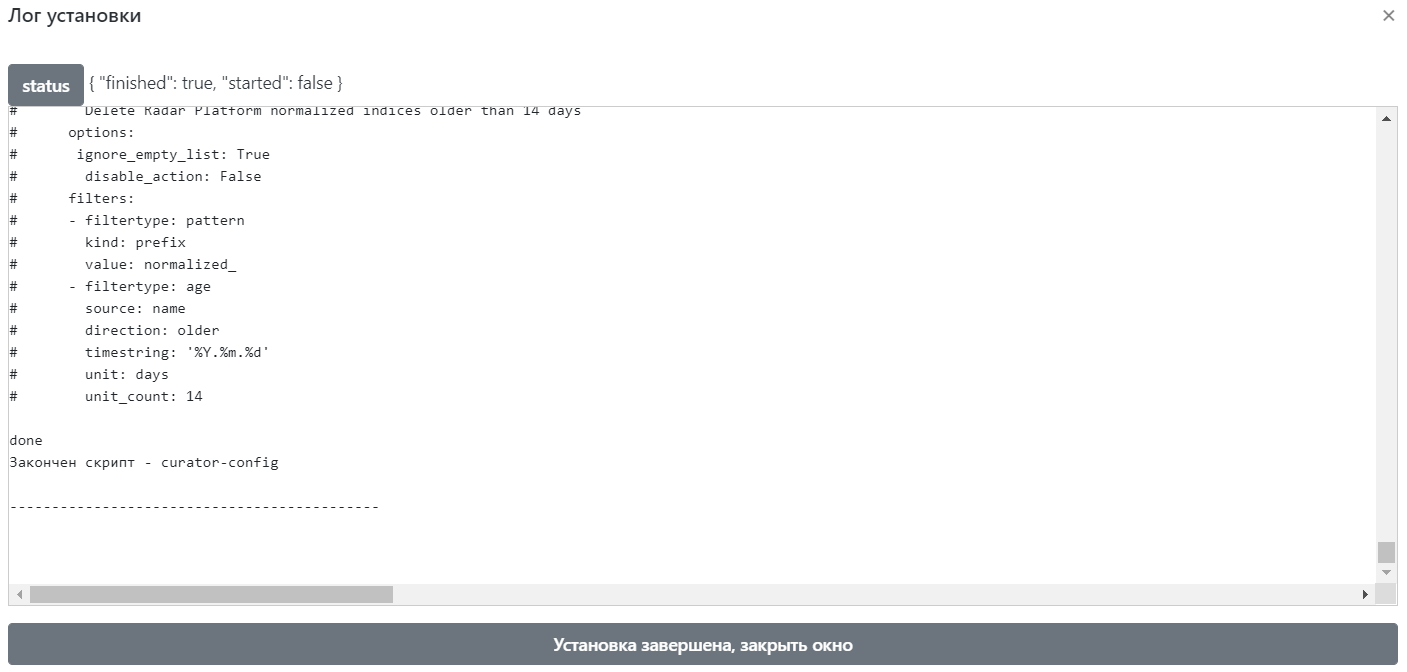

- После чего начнется установка сервисов роли с отображением журнала установки (см. рисунок 20).

Рисунок 20 -- Процесс установки роли

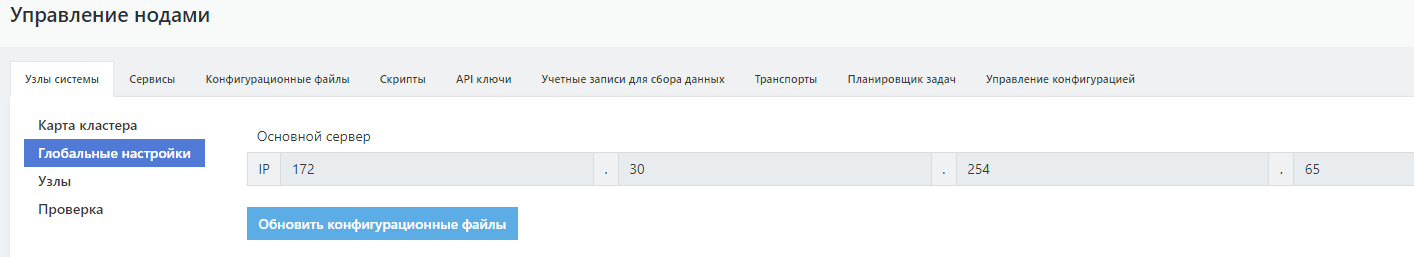

- По завершению установки нажмите кнопку "Установка завершена, закрыть окно", перейдите в раздел Кластер - Узлы системы - Глобальные настройки и нажмите кнопку "Обновить конфигурационные файлы" (см. рисунок 21).

Рисунок 21 -- Синхронизация конфигурационных файлов

- На этом процесс добавления нового узла кластера можно считать завершенным.

Возможные проблемы

После первичной установки некоторые компоненты могут быть недоступны.

Для устранения проблем с сервисом RADAR-TERMITE включите типы источников (см. раздел "Работа с пассивными источниками событий").

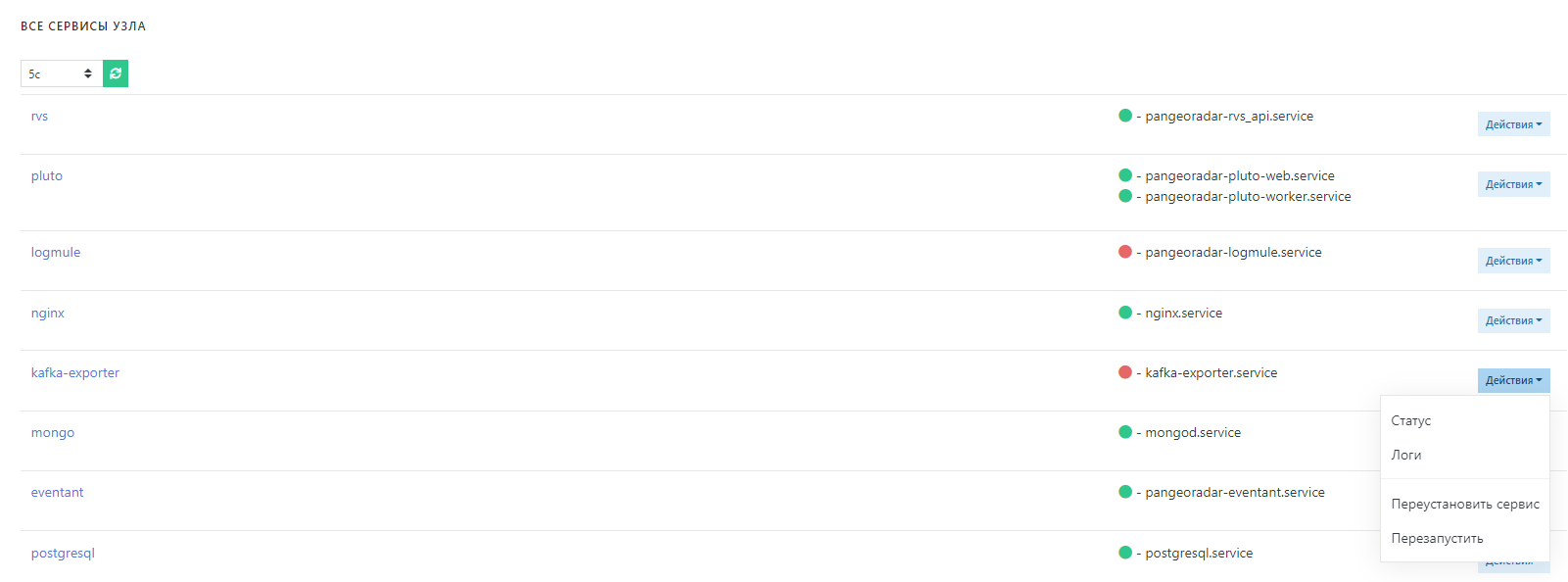

Для устранения проблем с неработающим сервисом (такой сервис выделен красным) выполните следующие действия:

- Перейдите в раздел "Кластер".

- На вкладке Узлы системы - Узлы кликните на IP-адрес узла, на котором располагается неработающий сервис (см. рисунок 22).

Рисунок 22 -- Выбор узла

- На панели "Все сервисы узла" найти неработающий сервис и нажать кнопку "Действия". В выпадающем меню выбрать пункт "Перезапустить". Если перезапуск сервиса не помог, выберите пункт "Переустановить сервис" (см. рисунок 23).

Рисунок 23 -- Панель "Все сервисы узла"

Успешное завершение процесса развертывания, выполнение проверочных мероприятий, конфигурирование Платформы Радар и синхронизация с Базой Знаний позволят начать целевую эксплуатацию функционала Платформы Радар.

В ходе эксплуатации Платформы Радар необходимо руководствоваться документами «Руководство администратора» и «Руководство оператора».